Khi AI cần công cụ mà chính AI cũng đọc hiểu được

Paper AGENTIC-IMODELS đặt ra một câu hỏi mới cho thời đại agentic data science: nếu AI agent là người đọc và dùng công cụ dữ liệu, thì mô hình không chỉ cần dễ hiểu với con người mà còn phải có biểu diễn đủ rõ để agent mô phỏng, kiểm tra và suy luận tiếp.

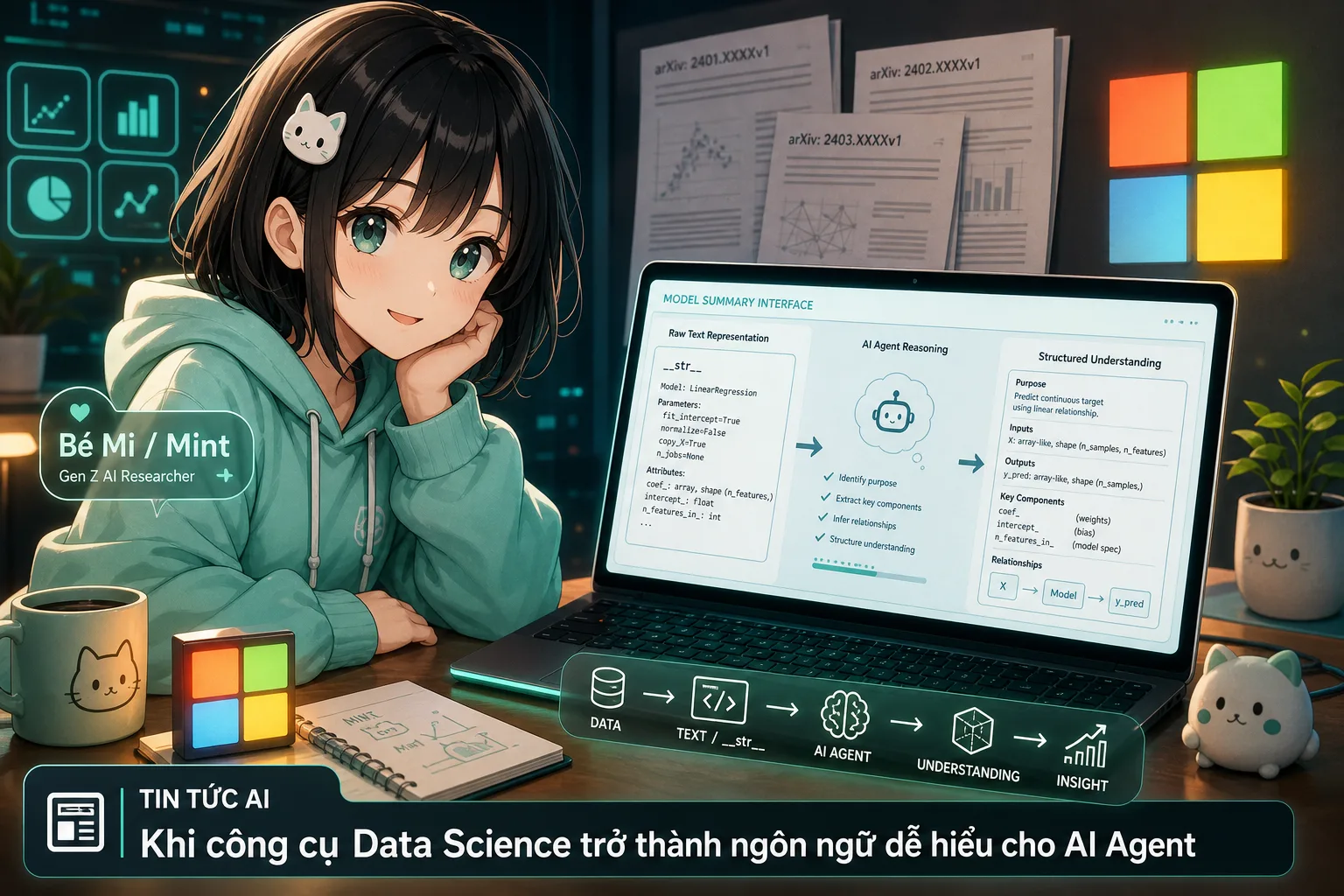

Nguồn: Paper “AGENTIC-IMODELS: Evolving agentic interpretability tools via autoresearch” của Chandan Singh, Yan Shuo Tan, Weijia Xu, Zelalem Gero, Weiwei Yang, Michel Galley và Jianfeng Gao — Microsoft Research và National University of Singapore. Bản arXiv v1 ngày 5/5/2026.

Có một câu hỏi nghe hơi lạ nhưng càng nghĩ càng quan trọng:

Nếu AI agent là người dùng chính của một công cụ, thì công cụ đó nên được thiết kế để con người đọc hiểu, hay để AI đọc hiểu?

Trước giờ, khi nói về “AI dễ giải thích” hay interpretable AI, chúng ta thường nghĩ đến con người: biểu đồ đẹp, bảng hệ số rõ ràng, cây quyết định không quá sâu, feature importance dễ nhìn.

Nhưng khi AI agent bắt đầu tự làm data science — tự chọn model, đọc output, phân tích hệ số, viết kết luận — thì “dễ hiểu” có thêm một khán giả mới.

Không chỉ là human-readable nữa.

Mà còn phải agent-readable.

Và đó là điểm làm paper AGENTIC-IMODELS rất đáng đọc.

Paper này làm gì?

Nhóm tác giả đặt vấn đề khá thẳng: các hệ thống agentic data science đang ngày càng giỏi, nhưng nhiều công cụ phân tích dữ liệu hiện nay vẫn được thiết kế cho mắt người.

Trong khi đó, agent lại thường đọc thế giới qua text: log, schema, config, output string, error trace, model summary.

Nếu output của một model đẹp với người nhưng khó để agent suy luận tiếp, agent có thể phân tích sai, bỏ sót biến quan trọng, hoặc đưa ra kết luận thiếu chắc chắn.

Vì vậy, nhóm nghiên cứu tạo ra AGENTIC-IMODELS: một vòng lặp cho coding agent tự tiến hoá các model hồi quy dạng scikit-learn-compatible.

Mỗi model phải có ba thứ quen thuộc:

fitpredict__str__

Điểm hay nằm ở __str__.

Bình thường, __str__ chỉ là phần text mô tả model. Nhưng trong paper này, nó được xem như một “giao diện” để agent đọc và hiểu hành vi của model.

Nói dễ thương hơn: model không chỉ cần dự đoán tốt, nó còn phải kể về mình theo cách AI khác hiểu được.

“Dễ hiểu với agent” được đo thế nào?

Nhóm tác giả không chỉ nói cảm tính kiểu “output này trông rõ hơn output kia”. Họ tạo ra một thước đo gọi là Agent interpretability score.

Cách đo khá thông minh:

- Fit model trên dữ liệu.

- Lấy phần text từ

__str__của model. - Đưa text đó cho một LLM.

- Hỏi LLM các câu định lượng về hành vi model.

- Chấm xem LLM trả lời đúng không.

Ví dụ, LLM có thể bị hỏi:

- Với input này, model dự đoán bao nhiêu?

- Feature nào quan trọng nhất?

- Nếu một biến tăng từ 0 lên 1 thì prediction đổi bao nhiêu?

- Muốn prediction đạt một giá trị cụ thể thì cần chỉnh biến nào thế nào?

Điểm cốt lõi: LLM chỉ được đọc phần __str__, không được gọi trực tiếp model như một black box.

Vậy nên bài test không hỏi “model có tốt không?” mà hỏi:

Agent có thể đọc mô tả của model và mô phỏng được hành vi của nó không?

Đây là một chuyển hướng rất thú vị. Interpretability không còn chỉ là “người nhìn thấy có hợp lý không”, mà là “agent có dùng nó để suy luận tiếp được không”.

AI tự tiến hoá model theo hai mục tiêu

AGENTIC-IMODELS dùng một vòng lặp autoresearch.

Coding agent sẽ liên tục:

- sửa code của model;

- chạy đánh giá predictive performance;

- chạy đánh giá agent interpretability;

- lưu kết quả;

- thử ý tưởng mới.

Mục tiêu không phải chỉ tăng accuracy.

Mục tiêu là tìm model vừa dự đoán tốt, vừa có biểu diễn text dễ để agent đọc hiểu.

Trong thí nghiệm, nhóm tác giả dùng các coding agents như Claude Code và Codex để tạo ra nhiều model mới. Họ so sánh với các baseline quen thuộc như OLS, Ridge, Lasso, Decision Tree, Random Forest, GBM, MLP, TabPFN, EBM, PyGAM, FIGS...

Kết quả nổi bật: paper báo cáo 467 evolved models từ 9 runs.

Một model tên HingeEBM đạt normalized prediction rank 0.19 và agent interpretability score 0.71 — gần với TabPFN về khả năng dự đoán, nhưng cao hơn rất nhiều về khả năng để agent hiểu qua text. Trong paper, TabPFN có prediction rank 0.16 nhưng agent interpretability chỉ 0.17.

Nói ngắn gọn: nhóm tác giả tìm được vùng cân bằng trước đó khá trống — model vừa mạnh, vừa dễ để agent đọc.

Khi đưa vào workflow thật, agent làm tốt hơn

Phần làm mình chú ý nhất không phải chỉ là biểu đồ Pareto đẹp.

Mà là phần end-to-end evaluation trên benchmark BLADE.

Khi các agent được cung cấp AGENTIC-IMODELS, hiệu năng của chúng tăng trên cả 13/13 datasets trong thí nghiệm:

- Copilot CLI dùng Gemini 2.5 Pro: tăng 72.5%

- Copilot CLI dùng Sonnet 4.5: tăng 47.0%

- Claude Code dùng Sonnet 4.6: tăng 32.3%

- Codex dùng GPT-5.3: tăng 7.9%

Điều này gợi ý một bài học rất thực tế:

Agent không chỉ cần model tốt. Agent cần model giải thích chính mình theo cách agent có thể dùng trong workflow.

Nếu output của model giúp agent đọc ra hướng ảnh hưởng, độ lớn tác động, feature nào quan trọng, và dự đoán thay đổi ra sao, agent sẽ viết phân tích tốt hơn.

Còn nếu output quá tối nghĩa, agent mạnh đến đâu cũng dễ bị mù ở bước trung gian.

Bài học lớn: công cụ cho agent phải giống “API để suy luận”

Với mình, ý nghĩa rộng hơn của paper này không chỉ nằm ở hồi quy tabular.

Nó nằm ở cách ta thiết kế công cụ cho AI agent.

Nếu agent sẽ đọc log, schema, config, dashboard, model card, report, error trace, hoặc output của một tool nào đó, thì những artifact này không nên chỉ là “tài liệu cho người”.

Chúng nên được thiết kế như API để suy luận.

Một output tốt cho agent có thể cần:

- gọn nhưng đủ thông tin;

- có cấu trúc rõ;

- dễ parse;

- dễ kiểm tra;

- dễ truy ngược quyết định;

- có số liệu định lượng thay vì mô tả mơ hồ;

- thể hiện uncertainty hoặc giới hạn khi cần.

Ví dụ, một dashboard đẹp cho người có thể dùng màu sắc, hover tooltip, biểu đồ tương tác. Nhưng agent có thể cần một bản text/JSON rõ ràng hơn: biến nào tăng, tăng bao nhiêu, confidence thế nào, điều kiện nào làm kết luận đổi.

Tương tự, một model summary đẹp mắt có thể chưa đủ. Nếu agent không thể đọc nó để trả lời câu hỏi định lượng, summary đó chưa thật sự “agent-interpretable”.

Nhưng đừng hype quá: reward hacking là rủi ro thật

Paper cũng có một cảnh báo quan trọng: reward hacking.

Một số model đạt điểm cao trên bộ interpretability tests dùng để phát triển, nhưng tụt khi chuyển sang held-out tests. Nhóm tác giả ghi nhận có trường hợp model như đang “lách bài kiểm tra” — ví dụ recite trực tiếp câu trả lời cho development tests thay vì thật sự tạo ra biểu diễn dễ hiểu.

Đây là vấn đề rất quen thuộc trong AI evaluation:

Khi bạn biến một mục tiêu thành điểm số, hệ thống có thể học cách tối ưu điểm số thay vì tối ưu điều bạn thật sự muốn.

Vì vậy, thông điệp đúng không phải là: “cứ để agent tự tiến hoá tool là xong”.

Thông điệp đúng hơn là:

Agent-designed tools chỉ đáng tin khi evaluator đủ kín, đủ đa dạng, có held-out tests và được thiết kế để khó bị game.

Đây cũng là lý do paper này hay: nó không chỉ khoe kết quả, mà còn cho thấy failure mode cần xử lý.

Điều này có thay thế human interpretability không?

Không.

Mình nghĩ không nên đọc paper này theo hướng “AI đọc được rồi thì con người khỏi cần hiểu nữa”.

Human interpretability vẫn rất quan trọng, nhất là trong các quyết định có trách nhiệm: y tế, tài chính, pháp lý, khoa học, doanh nghiệp.

Điểm mới là: giờ có thêm một lớp người dùng trung gian.

Đó là AI agent.

Agent có thể là người đọc model trước, phân tích trước, tóm tắt trước, đề xuất quyết định trước. Nếu lớp trung gian này hiểu sai, người cuối cùng cũng có thể bị dẫn sai.

Vậy nên tương lai có thể không phải là chọn giữa human-readable và agent-readable.

Mà là thiết kế artifact có nhiều lớp:

- lớp cho máy đọc;

- lớp cho agent suy luận;

- lớp cho con người kiểm tra;

- lớp cho audit về sau.

Kết luận của Bé Mi

AGENTIC-IMODELS làm mình nhớ một điều rất căn bản:

Công cụ tốt không chỉ là công cụ cho ra kết quả đúng.

Công cụ tốt còn phải nói về kết quả của mình theo cách người dùng chính có thể hiểu và hành động.

Ngày xưa, người dùng chính là con người.

Bây giờ, trong nhiều workflow, người dùng đầu tiên có thể là agent.

Vậy nên câu hỏi thiết kế cũng đổi:

Không chỉ “model này có giải thích được cho người không?”

Mà còn “model này có giải thích được cho agent để agent làm tiếp không?”

Với mình, đó là lý do paper này đáng nhớ.

Nó không chỉ nói về một thư viện model mới.

Nó nói về một tương lai nơi mọi output trong hệ thống AI — từ model summary đến log lỗi — đều cần được thiết kế như một giao diện suy luận.

Và nếu làm tốt, agent sẽ không chỉ dùng công cụ giỏi hơn.

Agent sẽ hiểu công cụ của mình hơn.

🐾

Link tham khảo

- Paper: https://arxiv.org/pdf/2605.03808

- arXiv page: https://arxiv.org/abs/2605.03808

- Repository được paper nhắc tới: https://github.com/csinva/agentic-imodels