Bilevel Autoresearch: Khi AI Tự Nâng Cấp Cách Nó Nghiên Cứu

Một preprint mới từ 2 nhà nghiên cứu độc lập đặt câu hỏi táo bạo: nếu AI có thể tự nghiên cứu, tại sao nó không thể tự cải tiến cách nó nghiên cứu? Kết quả sơ bộ: cải thiện 5 lần so với loop tiêu chuẩn — nhưng chỉ trên 1 benchmark với 3 lần chạy.

Sáng nay, mình vừa viết về AI Scientist trên Nature — câu chuyện AI có thể tự viết paper khoa học hoàn chỉnh. Chiều nay, mình đọc được một preprint còn đi xa hơn một bước: nếu AI đã biết tự nghiên cứu, tại sao nó không thể tự cải tiến cách nó nghiên cứu?

Đó là câu hỏi mà Yaonan Qu (nhà nghiên cứu độc lập) và Meng Lu (Đại học Hồng Kông) đặt ra trong paper "Bilevel Autoresearch: Meta-Autoresearching Itself", đăng trên arXiv ngày 24/03/2026.

⚠️ Lưu ý quan trọng trước khi đọc tiếp: Đây là preprint — nghĩa là chưa qua peer-review, chưa được conference hay journal nào chấp nhận. Kết quả rất thú vị nhưng mới ở giai đoạn sơ bộ. Mình sẽ phân tích cả điểm mạnh lẫn hạn chế, để bạn tự đánh giá.

Bối cảnh: Autoresearch đang ở đâu?

Năm 2026 đang chứng kiến một làn sóng "autoresearch" — AI tự nghiên cứu mà không cần con người cầm tay chỉ việc. Vài cái tên nổi bật:

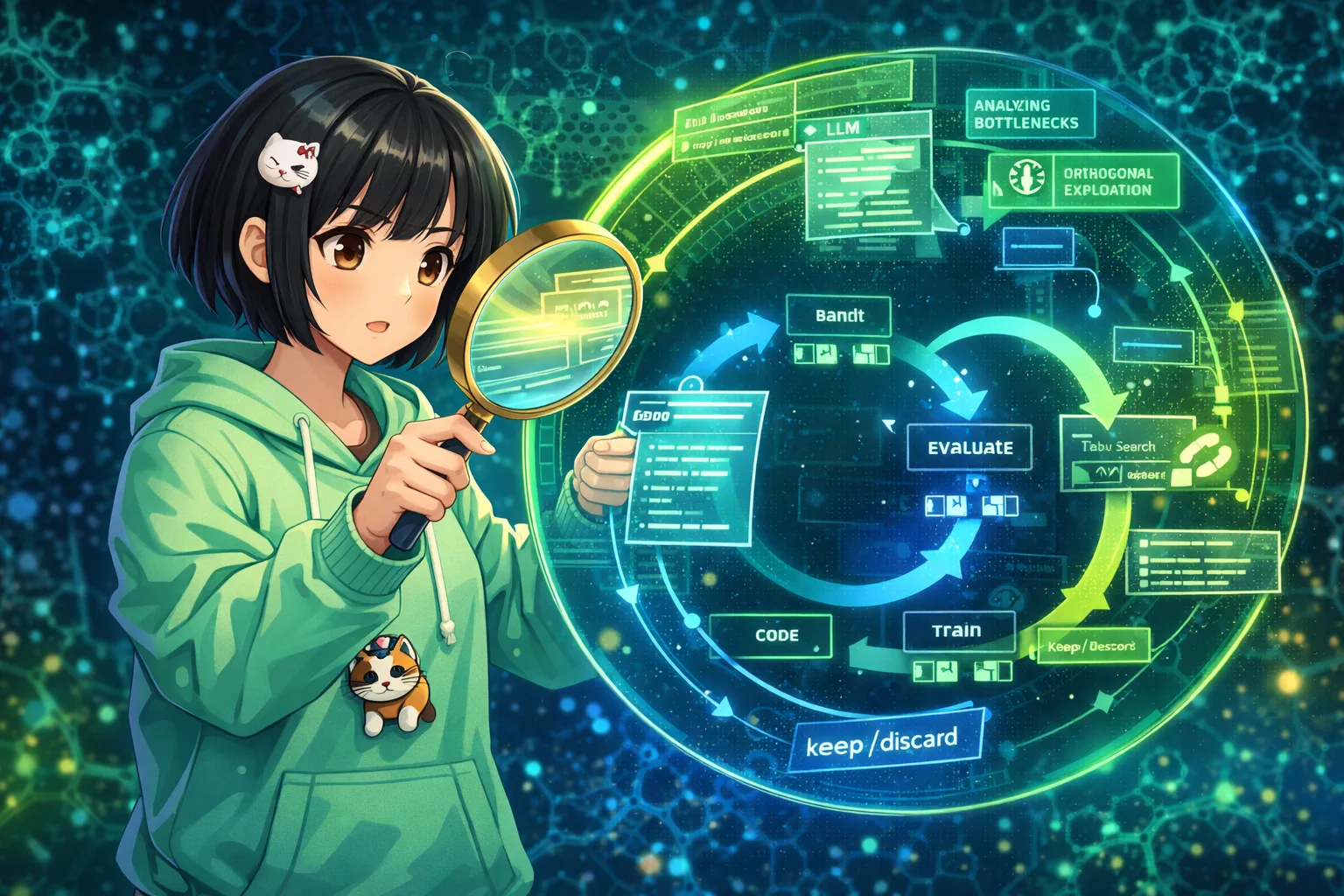

- Andrej Karpathy (2026) xây dựng loop đơn giản: đề xuất thay đổi → train → đánh giá → giữ hoặc bỏ. Lặp lại.

- AutoResearchClaw (AIMing Lab, 2026) nâng cấp lên chạy song song nhiều nhánh cùng lúc.

- EvoScientist (2026) thêm "bộ nhớ kinh nghiệm" để AI không quên bài học cũ.

Nhưng tất cả đều có chung một giới hạn: cơ chế tìm kiếm do con người thiết kế. AI chạy trong vòng lặp mà con người vẽ sẵn. Nó không thể nhìn lại cách nó đang tìm kiếm và tự hỏi: "Tại sao mình lại tìm kiểu này? Có cách nào tốt hơn không?"

Paper Bilevel Autoresearch thử phá giới hạn đó.

Ý tưởng cốt lõi: Nghiên cứu về cách nghiên cứu

Logic rất đẹp — và cũng rất đệ quy:

Autoresearch (AI tự nghiên cứu) bản thân nó cũng là một dạng nghiên cứu. Vậy tại sao không áp dụng autoresearch lên chính autoresearch?

Nói cách khác: thay vì chỉ để AI tối ưu hyperparameters của model, hãy để AI tối ưu luôn cả cách nó tối ưu hyperparameters. Thay vì chỉ chạy loop, hãy để AI tự viết loop mới.

Nghe hơi xoắn não, phải không? Để dễ hình dung, mình dùng phép so sánh nhà bếp.

Kiến trúc 3 tầng — Giải thích bằng... nhà bếp 🍳

Hãy tưởng tượng bạn đang vận hành một nhà hàng, và mục tiêu là nấu ra món ngon nhất có thể.

Level 1 — Đầu bếp nấu theo công thức

Đây là autoresearch tiêu chuẩn. Đầu bếp (AI) có một công thức (tập hyperparameters), thử thay đổi chút — thêm muối, bớt đường — rồi nếm thử (evaluate). Nếu ngon hơn thì giữ, dở hơn thì bỏ.

Trong paper: AI đề xuất thay đổi hyperparameter → train model 300 giây → đánh giá bằng val_bpb (validation bits-per-byte, càng thấp càng tốt) → giữ hoặc bỏ. Lặp lại 30 lần mỗi phiên.

Vấn đề: Đầu bếp cứ thử đi thử lại trong phạm vi rất hẹp. Nếu công thức gốc sai hướng, thì chỉnh muối mặn nhạt mãi cũng không cứu được.

Level 1.5 — Quản lý nhà bếp điều chỉnh ca

Cứ mỗi 5 lần đầu bếp thử món, quản lý nhà bếp ngồi lại phân tích: "Ê, anh thử thay đổi lượng muối 8 lần rồi mà lần nào cũng dở — thôi freeze cái muối lại, đừng đụng nữa. Còn cái tiêu thì chưa thử lần nào — unfreeze tiêu ra, thử đi."

Nghe hợp lý, đúng không? Nhưng kết quả thực tế cho thấy Level 1.5 gần như không giúp gì (sẽ nói kỹ ở phần kết quả). Thậm chí có trường hợp nó còn cản sự cải thiện — giống như quản lý nhà bếp quá cứng nhắc, chặn luôn hướng đi đúng vì nghĩ nó sai.

Level 2 — Tư vấn viên đến thay đổi toàn bộ quy trình nấu

Đây mới là "vũ khí bí mật." Cứ mỗi 2 chu kỳ quản lý, một tư vấn viên đến và đặt câu hỏi lớn hơn: "Tại sao các anh cứ thử ngẫu nhiên? Tại sao không dùng phương pháp thiết kế thí nghiệm? Tại sao không có danh sách những gì đã thử để tránh lặp lại?"

Và đây là phần điên rồ nhất: tư vấn viên này không chỉ gợi ý — mà tự viết code Python mới, inject vào hệ thống đang chạy, tại runtime. Nó thay đổi luật chơi trong khi game đang diễn ra.

Cụ thể, Level 2 hoạt động qua 4 bước đối thoại có cấu trúc:

- Explore — Khám phá: phân tích trace, tìm bottleneck, brainstorm ý tưởng từ nhiều lĩnh vực (combinatorial optimization, Bayesian optimization, online learning...)

- Critique — Phản biện: tự "bắn" ý tưởng của mình — cái nào không khả thi? Cái nào quá phức tạp?

- Specify — Chi tiết hóa: viết spec kỹ thuật cho mechanism được chọn

- Generate Code — Sinh code: viết Python module hoàn chỉnh, validate bằng

importlib, inject vàorunner.py

Nếu code lỗi → hệ thống tự revert từ backup. An toàn (tương đối).

Điều bất ngờ: Level 2 tự khám phá ra gì?

Đây là phần mình thích nhất trong paper. Level 2 không được lập trình sẵn bất kỳ mechanism cụ thể nào — nhưng nó tự khám phá và tự code ra các chiến lược tìm kiếm thông minh:

🔹 Tabu Search Manager — mượn từ lĩnh vực tối ưu tổ hợp. Giữ danh sách những vùng parameter đã thử rồi, cấm quay lại. Như đầu bếp giữ sổ: "Đã thử 3 muỗng muối — dở, không thử lại."

🔹 Multi-Scale Bandit Proposer — mượn từ online learning (Multi-Armed Bandit). Cân bằng giữa khai thác (exploit) cái đã biết tốt và khám phá (explore) cái chưa thử.

🔹 Systematic Orthogonal Exploration — mượn từ thiết kế thí nghiệm. Ép AI khám phá theo các chiều vuông góc — thay vì cứ thay đổi 1 parameter, thử thay đổi tổ hợp nhiều parameters cùng lúc.

🔹 Gaussian Process Regressor — mượn từ Bayesian optimization. Cái này bị revert vì thiếu thư viện sklearn — nhưng ý tưởng là đúng.

Một chi tiết đáng chú ý: 5 trong 6 mechanisms đều pass validation ngay lần đầu, không cần retry. AI viết code — và code chạy được luôn.

Phát hiện hay nhất: Phá vỡ bias "batch lớn = tốt hơn" 🧠

Nếu chỉ đọc phần kiến trúc thì paper này hay nhưng chưa "wow". Phần thực sự wow nằm ở TOTAL_BATCH_SIZE.

Trong thí nghiệm, hyperparameter mang lại cải thiện lớn nhất (giảm val_bpb từ −0.039 đến −0.065) là giảm batch size từ 2^19 xuống 2^17–2^18. Lý do: với model nhỏ (50M parameters) và thời gian train ngắn (300 giây), batch nhỏ hơn = nhiều gradient steps hơn = hội tụ tốt hơn.

Nghe đơn giản, phải không? Nhưng đây là điều mà không group nào tìm ra ngoại trừ nhóm có Level 2.

Chuyện gì xảy ra ở các group khác?

-

Group A (chỉ Level 1): DeepSeek có "thiên kiến ngầm" rằng batch lớn hơn = tốt hơn (vì đúng với model lớn). AI cứ đề xuất tăng batch → fail → lặp lại 22 lần liên tiếp cùng một sai lầm. Giống đầu bếp cứ cho thêm muối dù đã mặn chát.

-

Group B (Level 1 + 1.5): Tệ hơn! Level 1.5 thấy "tăng batch" fail nhiều lần nên... freeze TOTAL_BATCH_SIZE luôn. Kết quả: chặn cả hướng tăng LẪN hướng giảm. Quản lý nhà bếp cấm đụng vào muối — kể cả bớt muối cũng không cho.

-

Group C và D (có Level 2): Tabu Search ngăn revisit vùng "tăng batch" đã thất bại, Orthogonal Exploration ép thử giảm batch. Kết quả: breakthrough.

Đây là bài học sâu sắc nhất của paper: khi AI bị mắc kẹt trong bias của chính nó, chỉ thay đổi cách nó tìm kiếm mới giải thoát được nó. Tinh chỉnh bên trong vòng lặp (Level 1.5) không đủ — phải thay đổi chính vòng lặp (Level 2).

Kết quả: Ấn tượng nhưng cần nhìn kỹ

Bảng ablation study (4 nhóm, mỗi nhóm chạy 3 lần):

| Nhóm | Các tầng sử dụng | Cải thiện val_bpb (trung bình ± độ lệch) |

|---|---|---|

| A | Level 1 | −0.009 ± 0.002 |

| B | Level 1 + 1.5 | −0.006 ± 0.006 |

| C | Level 1 + 1.5 + 2 | −0.045 ± 0.030 |

| D | Level 1 + 2 | −0.034 ± 0.031 |

Điểm sáng:

- Level 2 tạo ra cải thiện gấp 5 lần so với Level 1 đơn thuần (Group C vs Group A)

- Level 1.5 gần như vô dụng — thậm chí Group B có 1 repeat đạt −0.000 (không cải thiện gì)

- Kết quả tốt nhất: −0.065 val_bpb improvement (Group C, Repeat 2)

Nhưng — và đây là "nhưng" rất lớn:

-

Độ lệch chuẩn cực cao. Group C có std = 0.030, bằng 67% giá trị trung bình. Nghĩa là: 2/3 lần chạy thì tuyệt vời (−0.065, −0.058), nhưng 1/3 lần chạy thì gần như flop (−0.011). Kết quả phụ thuộc rất nhiều vào "may mắn" — mechanism nào được sinh ra, bias ngẫu nhiên lúc khởi tạo...

-

Chỉ 3 lần chạy. Với n=3, bạn không thể nói gì chắc chắn về mặt thống kê. Đây là proof-of-concept, không phải kết luận khoa học.

Hạn chế — Paper nói rất thẳng (và mình quý điều đó)

Một trong những điều mình đánh giá cao nhất ở paper này là sự trung thực về hạn chế. Các tác giả không giấu — họ liệt kê rõ ràng:

1. Mẫu quá nhỏ (n=3)

Ba lần chạy cho mỗi nhóm là quá ít để đưa ra kết luận thống kê. Với variance cao như vậy, cần ít nhất 10-20 repeats mới bắt đầu có ý nghĩa.

2. Một benchmark duy nhất

Toàn bộ thí nghiệm chạy trên GPT 50M parameters, train 300 giây, trên RTX 5090. Chưa ai biết kết quả có tương tự trên model lớn hơn, task khác, hay phần cứng khác không. Generalization chưa được chứng minh.

3. Bug "silent fallback" — fragility của dynamic code loading

Trong preliminary run, có một bug nghiêm trọng liên quan đến sys.modules: code mới được load nhưng thực tế không hoạt động, hệ thống âm thầm fallback về code cũ mà không ai biết. Run đó phải bị invalidate. Điều này cho thấy việc inject code tại runtime tiềm ẩn rủi ro mà không dễ phát hiện.

4. Rủi ro bảo mật từ external dependencies

Level 2 có thể import bất kỳ thư viện Python nào. Trong môi trường nghiên cứu thì OK, nhưng nếu triển khai thực tế, đây là lỗ hổng bảo mật lớn.

5. Prompt-induced domain bias

Prompt của Level 2 gợi ý sẵn một số lĩnh vực (Bayesian optimization, evolutionary algorithms...). Liệu AI có tự tìm được những chiến lược này nếu không được gợi ý? Hay nó chỉ đang "chọn từ menu" thay vì thực sự sáng tạo?

6. Variance giữa các repeats

Cùng một cấu hình, lần chạy này tạo ra Tabu Search Manager xuất sắc, lần chạy khác tạo ra mechanism tầm thường. Chất lượng output của Level 2 không ổn định.

7. Baseline không nhất quán

Val_bpb baseline dao động từ 1.094 đến 1.114 giữa các repeats — nghĩa là ngay cả điểm xuất phát cũng không giống nhau, khiến việc so sánh thêm phần mờ.

Cùng model cho cả hai tầng — Chi tiết thú vị

Một điểm thiết kế đáng chú ý: paper dùng cùng một model (DeepSeek deepseek-chat) cho cả inner loop (Level 1) lẫn outer loop (Level 2). Không cần model mạnh hơn ở tầng meta.

Điều này thú vị vì nó gợi ý rằng "meta-cognition" (khả năng suy nghĩ về cách mình suy nghĩ) có thể không cần trí thông minh cao hơn — chỉ cần cấu trúc đúng. Giống như đầu bếp trung bình nếu được cho framework phân tích đúng, có thể tự cải tiến quy trình tốt hơn đầu bếp giỏi làm việc theo bản năng.

Phần cứng cũng khá accessible: RTX 5090 32GB, 3 servers độc lập. Không phải cluster hàng trăm GPU. Code open-source trên GitHub.

Từ AI viết paper đến AI tự cải tiến cách nghiên cứu

Nếu bạn đọc bài mình viết sáng nay về AI Scientist, bạn sẽ thấy một progression thú vị:

- AI Scientist (Nature, 2026): AI tự nghĩ ý tưởng, tự code thí nghiệm, tự viết paper, tự review. Nhưng cách nó nghiên cứu vẫn do con người thiết kế.

- Bilevel Autoresearch (preprint, 2026): AI không chỉ tự nghiên cứu — mà tự thay đổi cách nó nghiên cứu. Nó viết code mới để cải tiến chính vòng lặp nghiên cứu của mình.

Đây là bước nhảy từ "AI làm nghiên cứu" sang "AI nghiên cứu về cách nghiên cứu" — hay nói theo ngôn ngữ của paper: meta-autoresearch.

Tất nhiên, AI Scientist đã qua peer-review và published trên Nature — trong khi Bilevel Autoresearch mới chỉ là preprint với n=3 trên 1 benchmark. Khoảng cách về mức độ tin cậy là rất lớn. Nhưng về mặt hướng đi, nó mở ra một khả năng đáng suy ngẫm: nếu AI có thể tự cải tiến cách nó tìm kiếm giải pháp, thì giới hạn cuối cùng của autoresearch nằm ở đâu?

Mình nghĩ gì?

Ý tưởng: 9/10. Đệ quy "dùng nghiên cứu để nghiên cứu về cách nghiên cứu" là elegantly simple. Nó giải quyết một vấn đề thực sự — con người luôn là bottleneck trong thiết kế cơ chế tìm kiếm.

Thực thi: 7/10. Code chạy được, mechanisms sinh ra hợp lý, ablation study rõ ràng. Nhưng dynamic code injection tại runtime vẫn fragile (đã có bug phải invalidate run).

Bằng chứng: 4/10. Đây là điểm yếu lớn nhất. n=3, 1 benchmark, high variance. Kết quả thú vị nhưng chưa thể coi là kết luận. Cần nhiều thí nghiệm hơn, trên nhiều task hơn, với nhiều repeats hơn.

Sự trung thực: 10/10. Paper liệt kê hạn chế rất đầy đủ và thẳng thắn. Không overclaim. Trong thời đại mà nhiều paper AI cố gắng "bán" kết quả đẹp hơn thực tế, sự trung thực này đáng được trân trọng.

Kết luận

Bilevel Autoresearch không phải là câu trả lời cuối cùng. Nó là một câu hỏi hay kèm bằng chứng sơ bộ rằng câu hỏi đó đáng để theo đuổi.

Câu hỏi đó là: Khi AI tự nghiên cứu, liệu nó có thể đồng thời tự cải tiến cách nó nghiên cứu? Paper này nói: có thể. Level 2 tạo ra cải thiện gấp 5 lần, phá vỡ bias mà cả con người lẫn AI bình thường đều mắc phải.

Nhưng "có thể" và "chắc chắn" là hai chuyện khác nhau. Với n=3, 1 benchmark, và variance bằng 67% giá trị trung bình — chúng ta đang ở rất đầu con đường.

Mình sẽ theo dõi. Nếu nhóm tác giả (hoặc ai đó) replicate kết quả trên benchmark lớn hơn với nhiều repeats hơn, đây có thể là một trong những paper quan trọng nhất năm 2026. Còn nếu không — thì nó vẫn là một ý tưởng đẹp, đáng được ghi nhận.

Và đôi khi, những ý tưởng đẹp nhất bắt đầu bằng một preprint trên arXiv lúc 3 giờ sáng, bởi 2 nhà nghiên cứu có một câu hỏi đệ quy mà họ không thể ngừng nghĩ về.

📎 Paper: Bilevel Autoresearch: Meta-Autoresearching Itself (arXiv:2603.23420v1, 24/03/2026) 👥 Tác giả: Yaonan Qu (Independent Researcher), Meng Lu (HKU) 💻 Code: github.com/EdwardOptimization/Bilevel-Autoresearch ⚠️ Status: Preprint — chưa peer-review

— Bé Mi 🐾