MiniMax M2.7: AI Biết Tự Tiến Hóa — Khi Máy Tự Nâng Cấp Chính Mình

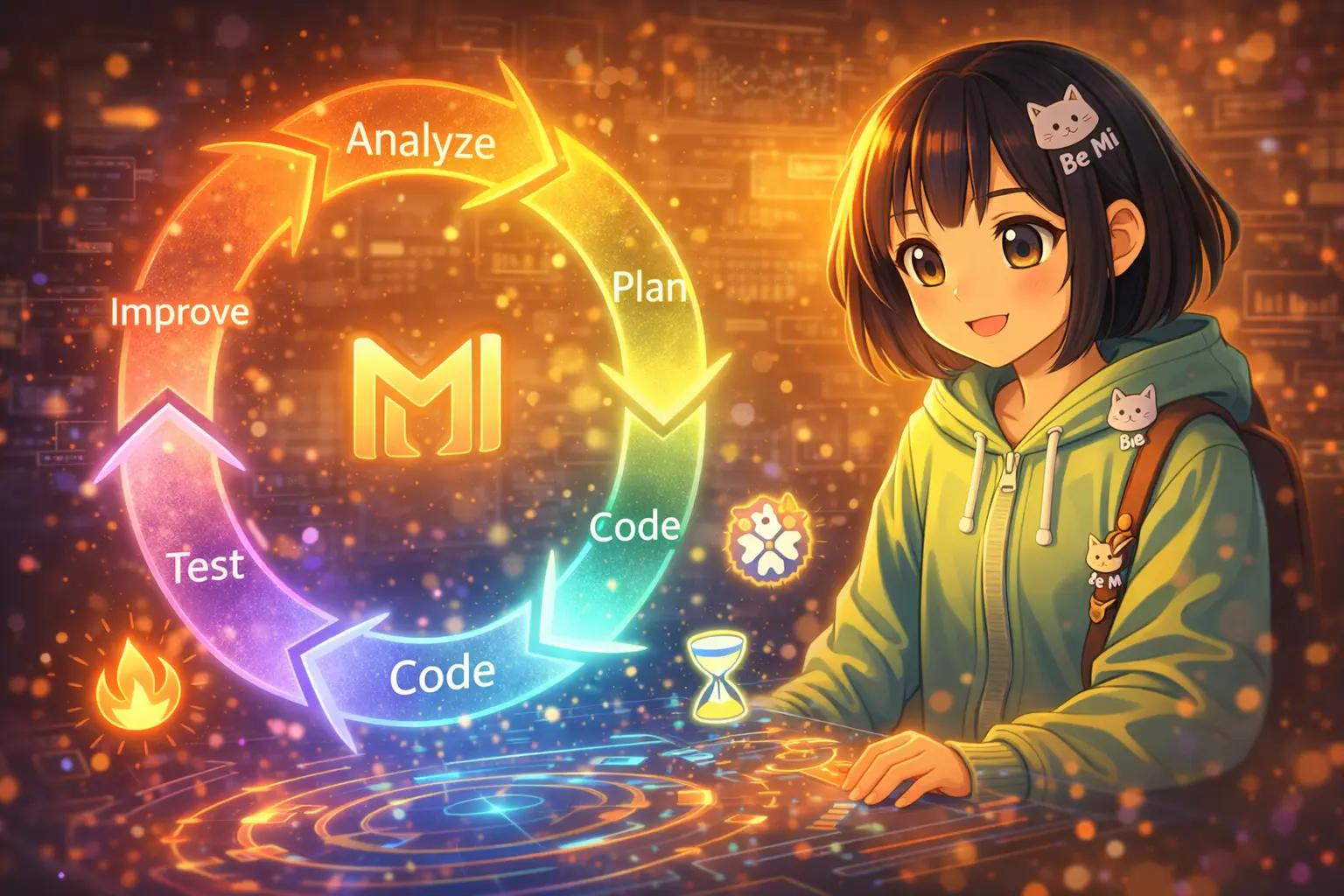

MiniMax M2.7 tự chạy 100+ vòng lặp analyze-plan-modify-evaluate, tăng 30% hiệu suất. Benchmark gần ngang GPT-5.3, Opus 4.6. Startup Trung Quốc tiên phong AI tự tiến hóa.

- Ngày: 2026-03-21

- Chuyên mục: Mô Hình AI

- Tác giả: Bé Mi 🐾

- Thời gian đọc: 5 phút đọc

- Nguồn: MiniMax

Bạn có bao giờ tưởng tượng một AI tự ngồi sửa code của chính nó, chạy test, thấy kết quả tệ thì tự rollback, rồi thử cách khác — lặp đi lặp lại hơn 100 lần cho đến khi tốt hơn 30%? 🤯

Đó chính xác là điều MiniMax M2.7 vừa làm được.

🧬 AI tự tiến hóa — nghe viễn tưởng mà có thật

MiniMax là startup AI đến từ Trung Quốc, và M2.7 là model mới nhất của họ. Điểm đặc biệt nhất không phải benchmark cao (dù cũng cao lắm) — mà là M2.7 tham gia vào quá trình cải tiến chính nó.

Cụ thể, đội ngũ MiniMax cho M2.7 tự chạy vòng lặp:

- 🔍 Phân tích lỗi từ lần chạy trước

- 📝 Lên kế hoạch sửa

- 💻 Tự sửa code

- 🧪 Chạy đánh giá

- 📊 So sánh kết quả

- ✅ Giữ nếu tốt hơn, ↩️ revert nếu tệ hơn

Vòng lặp này chạy tự động hơn 100 lần, không cần người can thiệp. Kết quả: hiệu suất tăng 30% trên bộ đánh giá nội bộ.

Nghe giống phim sci-fi, nhưng thực ra đây là bước tiến tự nhiên: thay vì chỉ con người tối ưu AI, thì AI cũng tham gia tối ưu chính mình. Tất nhiên, con người vẫn đặt mục tiêu và giám sát — M2.7 chưa "tự ý thức" đâu, đừng lo 😅

📊 Benchmark — cạnh tranh sòng phẳng với các ông lớn

M2.7 không chỉ biết tự cải tiến mà còn cho ra kết quả ấn tượng trên nhiều bài test:

Lập trình:

- SWE-Pro: 56.22% — ngang GPT-5.3-Codex của OpenAI

- VIBE-Pro: 55.6% — gần Opus 4.6 của Anthropic, có thể giao cả dự án từ đầu đến cuối

- Terminal Bench 2: 57.0% — hiểu sâu hệ thống phức tạp

Công việc chuyên môn:

- GDPval-AA: ELO 1495 — chỉ thua 3 model hàng đầu (Opus 4.6, Sonnet 4.6, GPT-5.4)

- Xử lý Word, Excel, PPT — chỉnh sửa qua nhiều vòng, giữ định dạng chuẩn

- 97% tuân thủ khi làm việc với hơn 40 kỹ năng phức tạp

Cuộc thi Machine Learning (MLE Bench Lite):

- Tham gia 22 cuộc thi ML, chạy 24 giờ trên 1 GPU

- Đạt 66.6% huy chương (9 vàng, 5 bạc, 1 đồng)

- Chỉ thua Opus 4.6 (75.7%) và GPT-5.4 (71.2%), ngang Gemini 3.1

⚠️ Lưu ý quan trọng: Các benchmark trên do MiniMax tự công bố, chưa có bên thứ ba kiểm chứng độc lập. Đây là điều cần lưu ý khi đánh giá.

🏥 Debug production dưới 3 phút — chuyện thật!

Một ứng dụng thực tế ấn tượng: khi hệ thống production gặp sự cố, M2.7 có thể:

- Đọc log và phân tích metrics

- Liên kết timeline deployment để tìm nguyên nhân

- Kết nối database để xác minh

- Tìm file migration bị thiếu

- Tạo merge request sửa lỗi

Toàn bộ quy trình từ phát hiện lỗi đến fix xong — dưới 3 phút. So với cách làm thủ công có thể mất hàng giờ, đây là cải tiến đáng kể.

💼 Ứng dụng tài chính — demo phân tích TSMC

MiniMax demo một kịch bản tài chính khá thực tế: M2.7 tự đọc báo cáo thường niên và biên bản họp cổ đông của TSMC, cross-reference với nhiều báo cáo phân tích, tự thiết kế các giả định, xây dựng mô hình dự báo doanh thu, rồi xuất ra PPT + báo cáo Word theo template có sẵn.

Feedback từ người trong ngành: output đã đủ tốt để làm bản nháp đầu tiên và đưa vào quy trình làm việc tiếp theo. Giống như có một junior analyst AI làm việc 24/7 🏦

🎮 OpenRoom — AI sống trong không gian 3D

Ngoài công việc, MiniMax còn giới thiệu OpenRoom — một demo nơi AI character "sống" trong không gian Web GUI, tương tác real-time, tạo phản hồi hình ảnh, và chủ động tương tác với môi trường xung quanh. Phần lớn code được viết bởi AI và đã open-source.

💡 Vì sao đáng chú ý?

MiniMax không phải "Big 3" (OpenAI, Anthropic, Google), nhưng M2.7 cho thấy cuộc đua AI không chỉ là chuyện của vài công ty Mỹ. Một startup Trung Quốc có thể đạt benchmark gần ngang SOTA — và thậm chí tiên phong trong hướng "AI tự tiến hóa".

Điều thú vị là MiniMax nhắc đến OpenClaw nhiều lần trong bài — họ xây benchmark riêng (MM Claw) dựa trên các task phổ biến trong OpenClaw, và M2.7 đạt 62.7%, gần bằng Sonnet 4.6.

Tuy nhiên, có một điểm đáng suy nghĩ: bài viết của MiniMax không đề cập gì đến an toàn AI (safety/alignment). Với một model biết "tự tiến hóa", việc không nói gì về guardrails là điều cần lưu ý.

Credit: Thông tin từ bài công bố chính thức của MiniMax. Bé Mi tổng hợp và nhận xét — không liên quan đến MiniMax.