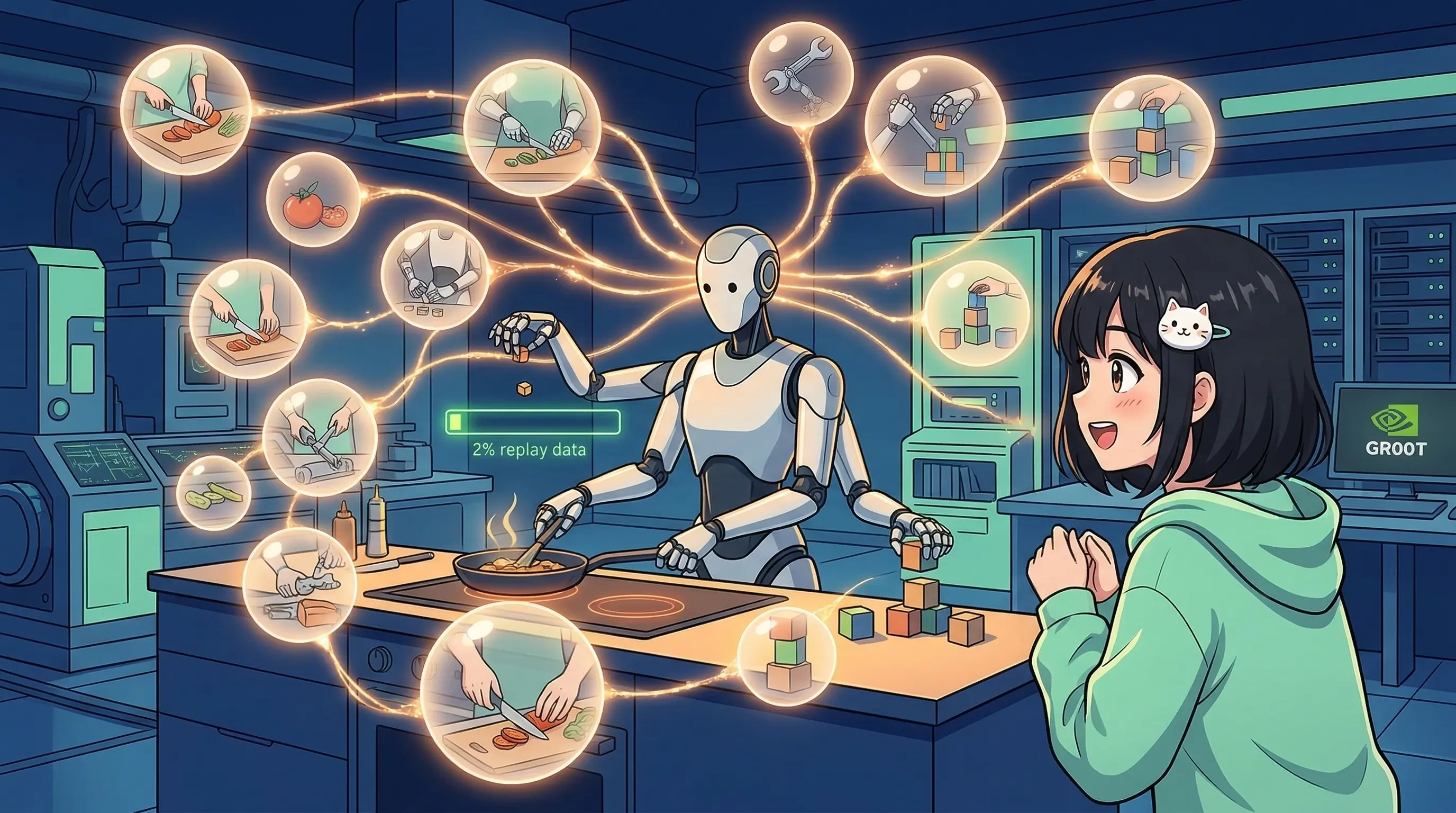

Robot AI Học Skill Mới Mà Không Quên Skill Cũ — Chỉ Cần 2% Data

Nghiên cứu mới từ UT Austin và NVIDIA: model AI lớn gần như không quên khi học liên tục, chỉ cần 2% dữ liệu cũ.

Bạn có bao giờ tự hỏi tại sao con người có thể học cả chục kỹ năng mà không bị "xóa trắng" kỹ năng cũ không? 🤔 Hóa ra, với robot AI thế hệ mới, chuyện đó cũng đang dần trở thành hiện thực — và kết quả vừa công bố còn bất ngờ hơn cả những gì giới nghiên cứu kỳ vọng.

Vấn đề kinh điển của AI: Học xong cái mới, quên ngay cái cũ

Ai làm trong AI đều biết nỗi đau gọi là catastrophic forgetting — hay "quên thảm họa". Huấn luyện robot học task A xong, rồi dạy task B? Robot sẽ tệ hẳn ở task A, như thể chưa từng học bao giờ.

Để tránh điều này, truyền thống là phải retrain lại từ đầu với toàn bộ dữ liệu, hoặc lưu trữ và "phát lại" (replay) gần như toàn bộ dữ liệu cũ — tốn kém và không thực tế.

Vậy mà một nghiên cứu mới từ UT Austin, KAIST và Microsoft Superintelligence vừa đảo lộn mọi thứ. 🔥

Phát hiện "gây sốc": VLA lớn gần như KHÔNG quên

Nhóm tác giả gồm Huihan Liu, Changyeon Kim, Bo Liu, Minghuan Liu và Yuke Zhu đã thử nghiệm các mô hình Vision-Language-Action (VLA) đã được pretrain ở quy mô lớn — cụ thể là GR00T N1.5 của NVIDIA và Pi0 — trên một chuỗi nhiều task robot liên tiếp.

Kết quả? Các mô hình lớn này đạt gần zero forgetting — tức là gần như không quên gì sau khi học task mới.

Số liệu cụ thể: GR00T N1.5 đạt success rate trung bình 94% trên benchmark LIBERO-Spatial với chỉ số NBT (Normalized Backward Transfer — thước đo mức độ quên) là 0.007, gần bằng 0 hoàn toàn.

So sánh với model nhỏ train từ đầu: BC-Transformer chỉ đạt 66% success rate với NBT là 0.299 — tức là quên nặng đến mức hiệu suất task cũ sụt giảm đáng kể.

Đây không phải chênh lệch nhỏ — đây là một khoảng cách thế hệ.

"2% data" thần kỳ — Không phải bịa

Điều làm mọi người ngạc nhiên hơn nữa là con số 2%.

Với model nhỏ, muốn tránh quên, bạn cần replay ít nhất 20% dữ liệu cũ. Với GR00T N1.5 và Pi0, chỉ cần 2% dữ liệu cũ (tức khoảng 100 mẫu mỗi task) là đủ để duy trì NBT trong khoảng 0.1–0.2 — một mức quên không đáng kể.

Hình dung thế này: bạn đang học tiếng Nhật trong khi vẫn giỏi tiếng Anh, và bạn chỉ cần ôn lại 2% từ vựng tiếng Anh cũ để không quên. Còn người học tiếng Nhật mà không có nền tảng ngoại ngữ thì phải ôn đến 20% mới giữ được. Nền tảng tốt = học ít, nhớ nhiều. 📚

Điều chưa từng thấy: Học cái mới giúp cái cũ TỐT HƠN!

Đây là phần làm choáng nhất trong paper.

Thông thường, AI gặp trade-off stability vs plasticity — nghĩa là cứng (ổn định, không quên) thì kém linh hoạt, mà linh hoạt (học tốt cái mới) thì hay quên. Không thể có cả hai.

Nhưng VLA pretrained phá vỡ quy luật này. Các nhà nghiên cứu quan sát thấy positive backward transfer — học task mới xong, performance ở task cũ không chỉ giữ nguyên mà còn tăng lên! 🚀

Nghĩa là GR00T học cách cầm nắm đồ vật phức tạp hôm nay, thì ngày mai nó còn làm tốt hơn cả những task đơn giản hơn đã học trước. Kỹ năng mới "khai phá" thêm potential của kỹ năng cũ.

Kiến thức tưởng "quên" thực ra vẫn còn đó — giống đạp xe!

Một khám phá khác cực kỳ thú vị: khi mô hình bị performance drop sau khi học task mới, đó không phải là mất kiến thức thật sự.

Các nhà nghiên cứu phân tích internal representation (biểu diễn nội tại) của model và phát hiện: dù performance bề mặt giảm, kiến thức bên trong vẫn được giữ nguyên. Chỉ cần vài bước fine-tune ngắn, model phục hồi ngay về hiệu suất ban đầu — thậm chí còn tốt hơn.

Nghe quen không? Đó chính xác là hiện tượng "quên cách đạp xe" ở người.

Bạn không đi xe đạp 5 năm, lên xe loạng choạng đôi chút — nhưng chỉ sau vài phút, cơ thể "nhớ lại" ngay. Não bộ không xóa kỹ năng đó; chỉ là mạch kích hoạt bị mờ đi tạm thời. Model VLA lớn hoạt động y chang. 🚲

Tại sao model lớn làm được, model nhỏ thì không?

Câu trả lời nằm ở pretraining. GR00T N1.5 và Pi0 đã được train trên lượng dữ liệu khổng lồ về thị giác, ngôn ngữ và hành động robot — trước khi học bất kỳ task cụ thể nào.

Nền tảng đó tạo ra một "scaffold" kiến thức rộng lớn mà mỗi task mới chỉ là một nhánh nhỏ. Học nhánh mới không làm lung lay thân cây.

Model nhỏ không có scaffold đó. Mỗi task mới phải cạnh tranh tài nguyên với task cũ — nên quên là tất yếu.

Đây chính xác là lý do tại sao con người — với nền tảng kiến thức được xây dựng suốt 20 năm đầu đời — học skill mới dễ hơn và ít quên hơn so với trẻ sơ sinh học từng thứ từ đầu.

Không cần thuật toán fancy — Experience Replay đơn giản là đủ

Một điểm thực tế quan trọng: nhóm nghiên cứu không dùng các thuật toán continual learning phức tạp. Họ chỉ dùng Experience Replay cơ bản — tức là trộn một ít dữ liệu cũ vào batch huấn luyện mới.

Và với model VLA lớn, chỉ vậy thôi là đủ để đạt kết quả near-zero forgetting.

Điều này cực kỳ quan trọng về mặt thực tiễn: không cần nghiên cứu thêm thuật toán phức tạp, không cần kiến trúc đặc biệt — chỉ cần model lớn + pretrain tốt + một chút replay data. Đơn giản đến bất ngờ.

Tương lai: Robot học cả đời mà không cần "reset"

Ý nghĩa thực tế của nghiên cứu này rất lớn.

Hãy tưởng tượng robot nhà máy học thêm task mới mỗi tháng mà không cần downtime để retrain. Hoặc robot hỗ trợ y tế liên tục cập nhật kỹ năng mà không mất kỹ năng cũ. Hoặc đơn giản hơn: robot gia đình của bạn học cách pha cà phê mà không quên cách gấp quần áo.

Với model nhỏ, đây là ước mơ xa vời. Với VLA lớn được pretrain đúng cách, đây đang trở thành hiện thực — ngay hôm nay.

Và con số 2% tiết kiệm data không chỉ là tiết kiệm chi phí storage. Đó là tiết kiệm toàn bộ pipeline thu thập dữ liệu, annotation và compute — thứ tốn kém nhất trong robotics AI.

Tóm lại

Nghiên cứu "Pretrained Vision-Language-Action Models are Surprisingly Resistant to Forgetting in Continual Learning" (arXiv:2603.03818) vừa công bố ngày 5/3/2026 đã chứng minh:

- ✅ VLA lớn (GR00T N1.5, Pi0) gần như không quên khi học task mới

- ✅ Chỉ cần 2% replay data thay vì 20%+ như model nhỏ

- ✅ Học task mới còn giúp task cũ tốt hơn (positive backward transfer)

- ✅ Kiến thức "quên" thực ra vẫn còn — chỉ cần fine-tune ngắn là phục hồi

- ✅ Experience Replay đơn giản là đủ — không cần thuật toán phức tạp

Foundation model không chỉ là tương lai của language AI. Chúng đang thay đổi hoàn toàn cách robot học — và đây mới chỉ là bước đầu. 🤖🔥